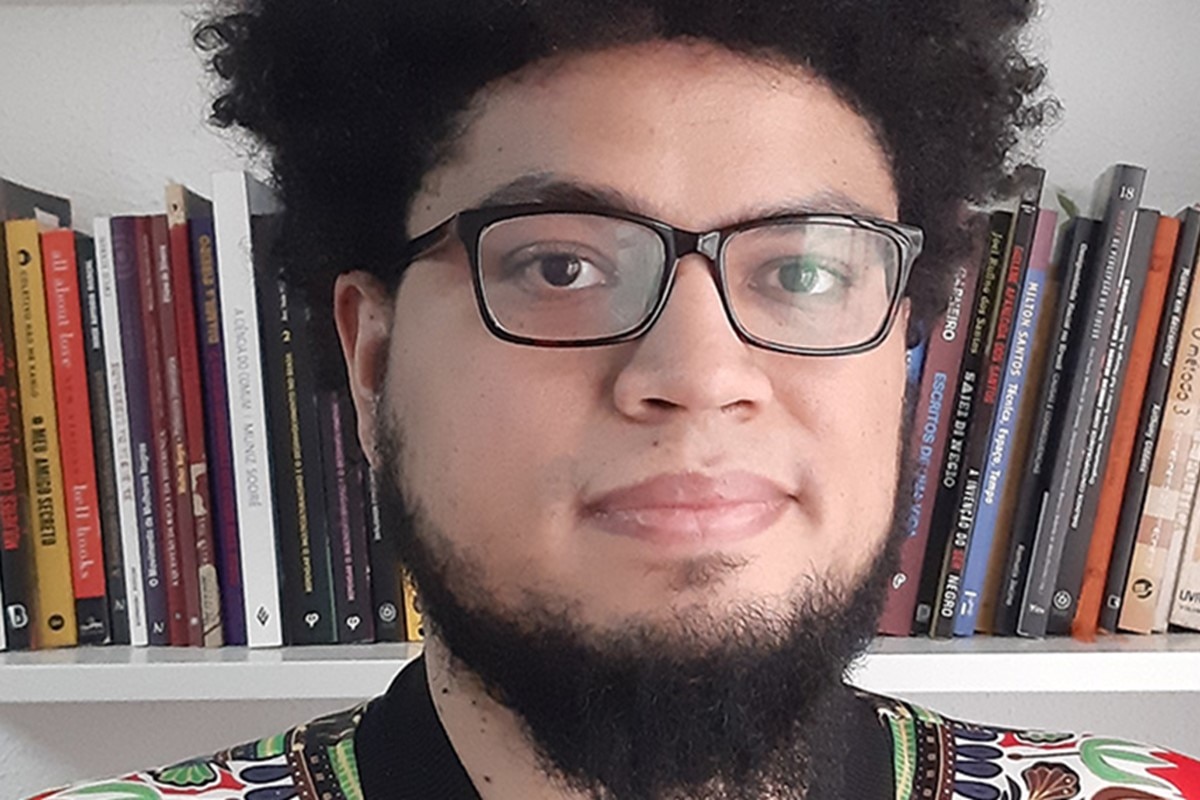

‘Reconhecimento facial impulsiona terror da polícia nas periferias’, diz pesquisador

Tarcízio Silva estuda racismo algorítmico e imaginários sociotécnicos de resistência. Para ele, a tecnologia não é neutra

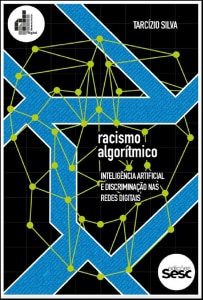

Os efeitos negativos da inteligência artificial e dos algoritmos, que podem influenciar o comportamento das pessoas, têm sido cada vez mais debatidos. O livro Racismo Algorítmico: Inteligência Artificial e Discriminação nas Redes Digitais (Edições Sesc), de Tarcízio Silva, colabora com a reflexão crítica.

A obra está entre os lançamentos de uma coleção sobre democracia digital. O tema é tratado de forma simples, “mas com responsabilidade”, afirma Tarcízio. Doutorando no Programa de Ciências Humanas e Sociais na Universidade Federal do ABC, o autor do livro estuda racismo algorítmico e imaginários sociotécnicos de resistência.

A realidade do Brasil, um dos países mais desiguais do mundo, conforme indica o World Inequality Lab (Laboratório das Desigualdades Mundiais), exige uma discussão minuciosa do assunto sobretudo para quem vive nas periferias. Segundo Tarcízio, os territórios e as pessoas são alvos constantes de violência e abandono do Estado por meio do qual o racismo algorítmico se vincula a práticas de hiper-vigilância.

O terror racial que Estado e polícia impõem às periferias pode ser impulsionado por uso de reconhecimento facial ou mesmo novas armas, como drones

“O terror racial que Estado e polícia impõem às periferias pode ser impulsionado por uso de reconhecimento facial ou mesmo novas armas, como drones”, diz o autor. “A marginalização econômica e política nessas regiões também abre espaço para o setor privado predatório.”

A marginalização econômica e política nessas regiões também abre espaço para o setor privado predatório

Tarcízio demonstra em seu trabalho como a coleta de dados sensíveis é usada de diversas formas, além do reconhecimento facial. Ela ocorre, por exemplo, em programas de assistência social, nas estratégias para determinar preços em aplicativos de transporte e serviços, no acesso à internet ou ainda em sistemas privados que oferecem descontos e programas de fidelidade.

Seu rosto, regra “deles”? — Implementações de reconhecimento facial na segurança pública são criticadas internacionalmente por promover a criminalização da pobreza.

No Brasil, alerta o pesquisador, a tecnologia chega a toque de caixa e com critérios frouxos. “[Fazem isso] ainda que os dados mostrem que ela é imprecisa contra minorias”, diz Tarcízio. “Até o reconhecimento facial que encontre efetivamente as pessoas suspeitas cadastradas em sua base é nocivo, sobretudo por causa das políticas desastrosas de encarceramento em massa e o policiamento racista focado em crimes sem vítimas ou na absurda proibição de substâncias como a cannabis.”

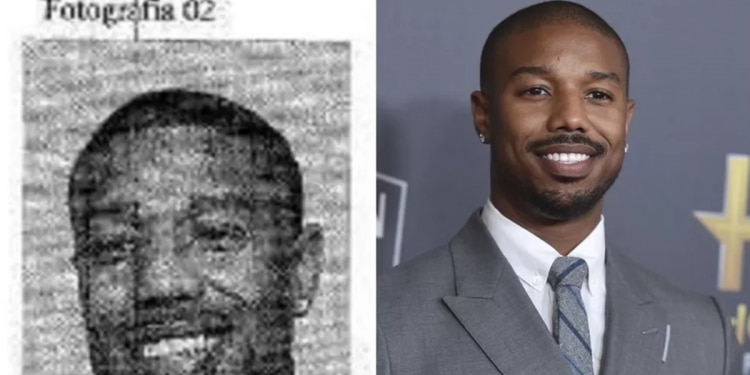

‘TRISTE E COMUM EXEMPLO DE RACISMO ALGORÍTMICO’ Um dos estados brasileiros a utilizar o reconhecimento facial no policiamento é o Ceará, onde a Polícia Civil mantém um catálogo fotográfico de suspeitos. Em janeiro deste ano, o sistema protagonizou um escândalo quando a foto do ator afro-americano Michael B. Jordan, astro de Pantera Negra, apareceu em uma lista de procurados pela polícia por uma chacina que deixou cinco pessoas mortas na noite de Natal de 2021. À época, a Polícia Civil emitiu uma nota em que informava que o trabalho de reconhecimento fotográfico é apenas uma das etapas que podem levar ao indiciamento de um acusado. Para Tarcízio, esse é um “triste e comum exemplo” do racismo algorítmico.

A inclusão de fotografias de inocentes, geralmente negros, em listas de procurados parte primeiro de séculos de exploração e opressão racial no País, afirma o pesquisador. “As abordagens discriminatórias do perfil considerado ‘suspeito’ por agentes na rua alimentam as bases com fotos de pessoas que sequer foram condenadas e que a partir daí podem ser enquadradas como criminosas por uma vítima descuidada ou por um policial negligente. É o racismo estrutural alimentado por dezenas e centenas de violências que se somam e destroem vidas. A algoritmização de sistemas de decisão tem o potencial de aumentar a velocidade e a escala desses processos, com o agravante de uma falsa aparência de neutralidade”, conclui.

‘A TECNOLOGIA NÃO É NEUTRA’ O interesse de Tarcízio Silva em pesquisar o racismo nos algoritmos não é algo novo, embora a obra sobre os danos na sociedade seja seu primeiro livro totalmente autoral. O pesquisador conta que na academia e no ativismo muitas pessoas negras têm discutido os impactos racializados da tecnologia em temas como discurso de ódio. Ele se soma ao trabalho de quem tem pavimentado pesquisas sobre o tema, entre eles Zelinda Barros, Alondra Nelson, Sil Bahia e Ivo Queiroz. “Entretanto, na maioria dos espaços hegemônicos da academia e nas instituições que definem políticas públicas, a relação entre racismo e tecnologias digitais era negada ou invisibilizada. Por exemplo, em um País marcado pelo genocídio negro, livros e pesquisas sobre práticas digitais de vigilância ignoravam o histórico escravista do país e como jovens negros são alvos da violência estatal”, relata. Para o pesquisador, ainda existe uma negação da existência do racismo associada à crença de que tecnologias são neutras. Até poucos anos atrás, diz, as tecnologias digitais pareciam afastadas das urgências dos negros: a fome, o desemprego e a violência estatal não pareciam problemas ligados a elas. “Por fim, o Brasil é apenas consumidor de grande parte das tecnologias e infraestruturas digitais que usamos no dia a dia. Sem o controle social soberano da tecnologia como acontece nos EUA ou na China, as reações de brasileiros a problemas provenientes de corporações globais enfrentam mais barreiras.”

Quer uma navegação personalizada?

Cadastre-se aqui

0 Comentários